L’intelligence artificielle conversationnelle a transformé notre manière d’interagir avec la technologie. Des outils comme ChatGPT sont devenus omniprésents, mais ils soulèvent des questions cruciales concernant la confidentialité des données et la dépendance à des services externes.

Cet article vous propose une alternative : l’installation et l’utilisation de LLM (Large Language Models) open source en local. Découvrez comment maîtriser votre IA, garantir la sécurité de vos informations et explorer une productivité souveraine grâce à des solutions comme Ollama et LM Studio.

Nous vous guiderons pas à pas à travers le processus d’installation, de configuration et d’utilisation de ces outils, vous permettant ainsi de bénéficier de la puissance de l’IA sans compromettre votre vie privée ni dépendre d’une connexion internet constante.

Table of Contents

Chapitre 1 — Libérez Votre Productivité : L’Ère des IA Locales et Gratuites

Êtes-vous, comme beaucoup, devenu dépendant de ChatGPT ou Claude pour vos tâches quotidiennes ? Imaginez la frustration de perdre cet accès lors d’un voyage sans Wi-Fi, ou l’inquiétude de partager des informations sensibles sur des plateformes externes. Fort heureusement, il existe une alternative : les IA locales et open source.

Cet article vous guide pas à pas dans l’installation et l’utilisation de ces outils, vous offrant une alternative ChatGPT sans internet performante, gratuite et sécurisée. Découvrez comment installer Llama 3.2 Windows, ou d’autres modèles, et optimiser votre flux de travail avec une IA locale gratuite sur votre propre machine. Ensemble, explorons comment reprendre le contrôle de vos données et booster votre productivité de manière souveraine.

Chapitre 2 — Découverte d’Ollama et LM Studio : Votre Premier Pas Vers l’Indépendance

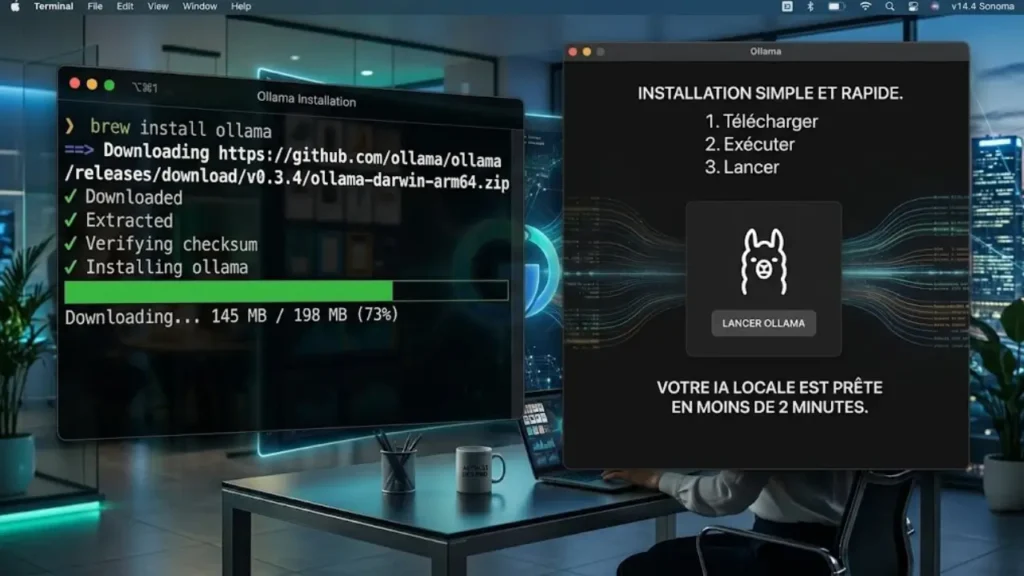

La première étape vers l’autonomie consiste à choisir votre moteur d’IA local. Deux options se distinguent : Ollama et LM Studio. Ollama agit comme le cœur de votre système, permettant de faire tourner des modèles open source sur Windows, Mac et Linux. Vous pouvez le télécharger directement sur le site officiel d’Ollama.

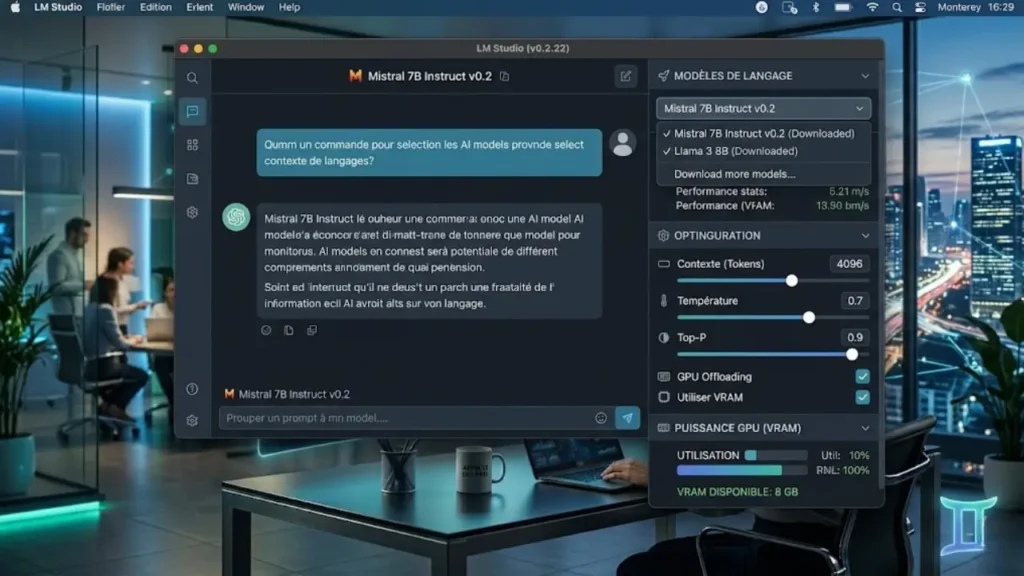

LM Studio, disponible sur LM Studio, offre une interface tout-en-un intuitive, idéale pour les débutants. Elle permet de tester facilement différents modèles et d’interagir avec eux via une interface conviviale. Pour les utilisateurs de Mac, Enchanted propose une alternative élégante, tandis que MSTY agrège les LLM locaux et cloud. L’installation est simple et vous ouvre les portes d’un monde d’IA personnalisable.

Chapitre 3 — Démonstration en Live : IA Locale en Action

🎥 Masterclass : Sujet : Installation et usage des LLM Open Source en local (Ollama, LM Studio). Objectif : Convertir l’audience « dépendante à ChatGPT » vers des solutions privées, gratuites et hors-ligne pour booster leur productivité souveraine.

Cette vidéo vous offre une démonstration concrète de l’utilisation d’IA locales. Vous y découvrirez comment installer et utiliser des modèles open source comme Mistral, DeepSeek ou Gemma directement sur votre ordinateur. L’accent est mis sur la simplicité d’installation et d’utilisation, même sans connexion internet.

L’intérêt principal réside dans la confidentialité des données et la gratuité de l’utilisation. Vous apprendrez à choisir le modèle adapté à vos besoins et à la puissance de votre ordinateur, tout en explorant des astuces pour optimiser votre configuration. Enfin, vous découvrirez des utilisations avancées, comme l’intégration avec n8n et Make pour l’automatisation de tâches.

Chapitre 4 — Enjeux et Opportunités de l’IA Locale : Vers une Productivité Souveraine

L’essor des IA locales représente une révolution dans notre manière d’interagir avec l’intelligence artificielle. Au-delà de la simple commodité, il s’agit d’un enjeu de souveraineté numérique. En maîtrisant l’architecture système et le déploiement de nos propres modèles, nous réduisons notre dépendance aux géants de la tech et renforçons la conformité de nos opérations.

L’IA confidentielle entreprise devient alors une réalité accessible, permettant d’optimiser ses flux de revenus et d’innover en toute sécurité. L’automatisation sémantique et l’analyse prédictive, autrefois réservées aux grandes entreprises, se démocratisent, ouvrant la voie à une nouvelle ère de productivité et de création de valeur ajoutée.

Chapitre 5 — LES FONDAMENTAUX À MAÎTRISER

L’adoption des LLM Open Source en local représente un changement de paradigme pour les professionnels habitués à la commodité des solutions cloud comme ChatGPT. Comprendre les bases est crucial pour une transition réussie.

Le premier concept à saisir est la distinction entre un modèle propriétaire (ChatGPT) et un modèle open source (Mistral). Le premier est hébergé et exécuté sur les serveurs du fournisseur, tandis que le second peut être téléchargé et exécuté sur votre propre machine. Cette autonomie offre un contrôle accru sur vos données et une indépendance vis-à-vis d’une connexion internet.

Un autre élément fondamental est la compréhension des ressources matérielles nécessaires. L’exécution de LLM nécessite une puissance de calcul significative, notamment au niveau du GPU et de la VRAM. Plus le modèle est grand (nombre de paramètres), plus les exigences matérielles sont élevées. Il est donc essentiel d’évaluer les capacités de votre machine avant de choisir un modèle.

Enfin, il est important de se familiariser avec les différents outils disponibles pour installer et gérer ces modèles. Des solutions comme Ollama et LM Studio simplifient grandement le processus, mais une compréhension de leurs fonctionnalités et de leurs limites est nécessaire pour une utilisation optimale. Maîtriser ces fondamentaux vous permettra d’exploiter pleinement le potentiel des IA locales et d’optimiser vos flux de revenus.

Chapitre 6 — LES OUTILS & RESSOURCES ESSENTIELS

Pour se lancer dans l’aventure des LLM Open Source en local, il est crucial de s’équiper des bons outils et de connaître les ressources pertinentes. Plusieurs options s’offrent à vous, chacune avec ses avantages et ses inconvénients.

Ollama se positionne comme un gestionnaire de modèles simple et efficace, compatible avec Windows, Mac et Linux. Il permet de télécharger, d’exécuter et de gérer facilement différents modèles open source via une interface en ligne de commande. Pour une expérience utilisateur plus conviviale, vous pouvez l’associer à une interface graphique comme Enchanted pour les utilisateurs Mac, ou MSTY qui agrège les LLM locaux et cloud.

LM Studio offre une solution tout-en-un, intégrant à la fois le gestionnaire de modèles et une interface utilisateur intuitive. Il permet de télécharger, d’exécuter et de tester des modèles directement depuis l’application, sans nécessiter de configuration complexe. Son mode « Power User » donne accès à des fonctionnalités avancées, comme l’API locale, qui peut être exploitée pour l’automatisation.

Pour l’automatisation, n8n se révèle être un outil puissant et flexible. Vous pouvez l’installer en local via NPX et l’utiliser pour orchestrer vos agents IA et automatiser des tâches complexes. Si vous souhaitez connecter votre API locale LM Studio à des outils cloud, Ngrok () vous permettra de créer un tunnel sécurisé. Make offre une alternative pour connecter votre IA locale avec d’autres applications.

Enfin, pour le développement, l’extension Continue.dev pour VS Code vous permet de coder localement avec Ollama, offrant une expérience de développement intégrée. Pour découvrir et télécharger des modèles open source, Hugging Face est une ressource incontournable. N’oublions pas Mistral AI , la pépite française qui propose des modèles performants et open source. Pour maîtriser l’automatisation avec ces outils, consultez notre guide sur l’automatisation IA avec Nano Banana Pro et n8n.

Chapitre 7 — TABLEAU COMPARATIF — CHAPITRE STRATÉGIQUE

Le choix de l’outil approprié dépend de vos besoins spécifiques, de votre niveau de compétence technique et de votre infrastructure existante. Ce tableau comparatif vous aidera à prendre une décision éclairée.

| Caractéristique | Ollama | LM Studio | Enchanted | n8n | Ngrok |

|---|---|---|---|---|---|

| Type | Backend (gestionnaire de modèles) | All-in-one (gestionnaire + interface) | Interface graphique (Mac) | Outil d’automatisation | Tunnellisation |

| Système d’exploitation | Windows, Mac, Linux | Windows, Mac, Linux | Mac uniquement | Windows, Mac, Linux (via Node.js) | Windows, Mac, Linux |

| Facilité d’utilisation | Intermédiaire (ligne de commande) | Facile (interface graphique) | Facile (interface graphique) | Intermédiaire (interface visuelle) | Facile (ligne de commande ou interface) |

| Fonctionnalités principales | Téléchargement, exécution, gestion de modèles | Téléchargement, exécution, test de modèles, API locale | Interface conviviale pour Ollama | Orchestration d’agents IA, automatisation | Exposition sécurisée d’API locales |

| Cas d’utilisation | Développeurs, utilisateurs avancés | Débutants, utilisateurs intermédiaires | Utilisateurs Mac préférant une interface graphique | Automatisation complexe, intégration avec d’autres outils | Accès à l’API locale depuis des outils cloud |

| Configuration requise | Dépend du modèle choisi | Dépend du modèle choisi | Dépend d’Ollama | Dépend des workflows | Dépend du trafic |

| Prix | Gratuit (Open Source) | Gratuit (Open Source) | Gratuit (Open Source) | Gratuit (Open Source) | Gratuit (avec limitations), payant pour les fonctionnalités avancées |

| Scalabilité | Dépend de l’infrastructure | Dépend de l’infrastructure | Dépend d’Ollama | Scalable avec une infrastructure appropriée | Scalable avec une infrastructure appropriée |

| Sécurité | Local, contrôle total des données | Local, contrôle total des données | Dépend d’Ollama | Dépend de la configuration | Tunnel sécurisé |

| Intégration | Continue.dev (VS Code), Enchanted, MSTY | Make | Ollama | Ollama, API | LM Studio, API |

Ce tableau met en évidence les forces et les faiblesses de chaque outil, vous permettant de choisir celui qui correspond le mieux à votre stratégie. L’infrastructure locale offre une conformité accrue et une analyse prédictive plus fine. Pour une vision plus large de l’écosystème, explorez notre article sur l’architecture Platinium SEO et la domination IA.

Chapitre 8 — LES ERREURS CRITIQUES À ÉVITER

L’adoption des LLM Open Source en local peut être semée d’embûches. Voici quelques erreurs fréquentes à éviter pour garantir une expérience optimale.

- Sous-estimer les exigences matérielles: Tenter d’exécuter un modèle trop grand sur une machine insuffisamment puissante entraînera des performances médiocres et une expérience utilisateur frustrante.

- Problème: Lenteur excessive, plantages, incapacité à exécuter le modèle.

- Solution: Évaluer les capacités de votre GPU et de votre VRAM. Choisir un modèle adapté à votre configuration matérielle. Commencer avec des modèles plus petits (moins de paramètres) et augmenter progressivement.

- Négliger la sécurité: Même si les LLM locaux offrent un contrôle accru sur les données, il est important de prendre des mesures de sécurité appropriées.

- Problème: Exposition des données sensibles, vulnérabilités potentielles.

- Solution: Mettre en œuvre des pratiques de sécurité robustes, telles que le chiffrement des données, la gestion des accès et la surveillance des activités suspectes. Utiliser des outils de tunnélisation sécurisés comme Ngrok pour exposer l’API locale.

- Ignorer les limitations des modèles: Tous les modèles ne sont pas égaux. Certains sont spécialisés dans des tâches spécifiques (génération de code, résumé de texte, etc.), tandis que d’autres sont plus généralistes.

- Problème: Résultats insatisfaisants, incapacité à atteindre les objectifs.

- Solution: Choisir un modèle adapté à vos besoins spécifiques. Expérimenter avec différents modèles pour trouver celui qui offre les meilleurs résultats. Consulter la documentation et les benchmarks pour évaluer les performances des différents modèles.

- Oublier l’optimisation: Même avec un matériel adéquat et un modèle approprié, il est possible d’améliorer les performances en optimisant la configuration.

- Problème: Performances suboptimales, consommation excessive de ressources.

- Solution: Ajuster les paramètres de configuration, tels que le nombre de threads et la taille du cache. Utiliser des outils de profilage pour identifier les goulots d’étranglement et optimiser le code.

En évitant ces erreurs courantes, vous maximiserez les bénéfices des LLM Open Source en local et optimiserez vos flux de revenus. Pour plus d’informations sur l’automatisation avec n8n, consultez notre article sur les agents IA autonomes et le RAG.

Chapitre 9 — STRATÉGIE AVANCÉE NIVEAU 1 : Orchestration via Tunnels Sécurisés

Pour exploiter pleinement le potentiel de LM Studio au sein de votre écosystème numérique, une stratégie consiste à exposer son API locale à des outils cloud via un tunnel sécurisé. Ceci permet d’intégrer vos LLM locaux dans des workflows d’automatisation plus vastes, tout en préservant la confidentialité de vos données.

L’outil Ngrok joue un rôle crucial dans cette architecture système. Il crée un tunnel sécurisé entre votre machine locale et le monde extérieur, permettant à des services cloud comme Make ou n8n d’interagir avec l’API de LM Studio. Cette approche ouvre des perspectives d’automatisation sémantique sophistiquées, allant de l’analyse de sentiments à la génération de contenu, le tout en local.

Chapitre 10 — CAS CONCRET & EXEMPLE RÉEL : Automatisation d’Emailing Sécurisé

Prenons l’exemple d’une entreprise souhaitant automatiser la création d’emails personnalisés, tout en garantissant la conformité des données de ses clients. L’utilisation de ChatGPT ou d’autres services cloud soulève des questions de confidentialité.

La solution consiste à installer LM Studio en local, à le connecter à un modèle open source comme Mistral 7B, puis à exposer son API via Ngrok. Ensuite, un workflow n8n est configuré pour récupérer les données clients depuis une base de données sécurisée, générer le contenu de l’email via l’API de LM Studio, et enfin l’envoyer via un service d’emailing respectant les normes de confidentialité. Le résultat est une automatisation complète, sécurisée et conforme.

Chapitre 11 — L’ANGLE EXPERT — CE QUE LES AUTRES NE DISENT PAS : Audit et Gouvernance des Modèles

L’avantage souvent négligé des LLM open source réside dans la possibilité d’un audit complet du modèle. Contrairement aux boîtes noires propriétaires, vous pouvez examiner le code, les données d’entraînement, et les biais potentiels.

Cette transparence est cruciale pour la gouvernance des IA, en particulier dans les secteurs réglementés. Vous pouvez ainsi adapter le modèle à vos besoins spécifiques, et implémenter des mécanismes de contrôle pour garantir son intégrité et sa fiabilité. C’est un atout majeur pour les entreprises soucieuses de la conformité et de l’éthique. Le téléchargement des modèles depuis Hugging Face est également une garantie de transparence.

Chapitre 12 — OPTIMISATION & PERFORMANCE : Scalabilité et Analyse Prédictive

L’optimisation des performances des LLM locaux passe par une allocation judicieuse des ressources hardware. La VRAM de votre GPU est le facteur limitant principal. L’analyse prédictive de la charge de travail permet d’anticiper les besoins en ressources et d’adapter la configuration en conséquence.

La scalabilité peut être améliorée en distribuant la charge de travail sur plusieurs machines locales, chacune hébergeant une instance de LM Studio. Des outils de monitoring permettent de suivre les KPIs clés (temps de réponse, utilisation CPU/GPU) et d’identifier les goulots d’étranglement. L’objectif est d’atteindre un niveau de performance optimal, tout en maîtrisant les coûts et en garantissant la disponibilité du service. L’amélioration continue de votre infrastructure est essentielle.

Chapitre 13 — INTÉGRATION DANS UNE STRATÉGIE GLOBALE

L’adoption de modèles de langage open source en local ne doit pas être perçue comme une simple curiosité technique. Elle s’inscrit dans une stratégie globale d’optimisation de vos flux de revenus et de renforcement de votre souveraineté numérique.

Considérez l’installation d’Ollama ou de LM Studio comme un investissement dans une infrastructure capable d’accroître votre productivité tout en protégeant vos données sensibles. Cette démarche est particulièrement pertinente dans un écosystème numérique où la conformité et la sécurité deviennent des enjeux majeurs.

En intégrant ces outils à votre architecture système, vous créez un environnement de travail plus flexible et résilient, capable de s’adapter aux contraintes de connectivité et aux exigences de confidentialité. Pensez à la scalabilité de votre solution : comment ces modèles locaux peuvent-ils s’intégrer à vos processus existants et accompagner votre croissance ?

Chapitre 14 — LES TENDANCES & L’ÉVOLUTION À VENIR

L’avenir des LLM open source en local s’annonce prometteur, avec une accélération de l’innovation et une démocratisation de l’accès à l’IA. Nous anticipons une augmentation de la puissance de calcul des appareils personnels, rendant possible l’exécution de modèles de plus en plus complexes.

L’automatisation sémantique jouera un rôle clé dans l’amélioration de l’expérience utilisateur, avec des interfaces plus intuitives et des fonctionnalités avancées. L’analyse prédictive permettra d’anticiper les besoins des utilisateurs et de personnaliser les réponses des modèles.

Gardez un œil sur les contributions de Mistral AI , la pépite française qui repousse les limites de l’IA open source. La gouvernance des données et la conformité réglementaire seront des enjeux cruciaux, nécessitant une approche proactive et responsable. L’agrégateur MSTY pourrait simplifier l’accès à de nombreux LLM, tant locaux que cloud.

Chapitre 15 — PLAN D’ACTION CONCRET — ÉTAPES IMMÉDIATES

Pour convertir efficacement votre audience vers des solutions privées, gratuites et hors ligne, voici un plan d’action en plusieurs étapes :

- Audit de vos besoins : Identifiez les tâches pour lesquelles vous utilisez actuellement ChatGPT et évaluez si un modèle local pourrait les réaliser aussi bien, voire mieux.

- Installation d’Ollama ou LM Studio : Téléchargez le moteur sur le site officiel de Ollama ou LM Studio et suivez les instructions d’installation pour votre système d’exploitation. Si vous êtes un utilisateur Mac, Enchanted pourrait être une interface élégante.

- Choix du modèle : Explorez les modèles disponibles sur Hugging Face et téléchargez ceux qui correspondent à vos besoins et à la puissance de votre ordinateur. Mistral 7B est un bon point de départ.

- Test et optimisation : Expérimentez avec différents modèles et paramètres pour optimiser les performances et la qualité des résultats. Surveillez l’utilisation de la VRAM de votre GPU.

- Intégration à vos workflows : Explorez les possibilités d’intégration avec des outils d’automatisation comme n8n ou Make pour créer des processus automatisés basés sur l’IA locale.

- Sécurisation de l’accès : Si vous devez exposer votre API locale, utilisez un outil de tunneling sécurisé comme Ngrok pour protéger vos données.

- Formation et documentation : Formez votre équipe à l’utilisation des LLM open source en local et créez une documentation claire et concise pour faciliter leur adoption.

Chapitre 16 — LE COIN DES ASTUCES DES PRO — VALEUR EXCLUSIVE

Voici quelques astuces pour tirer le meilleur parti des LLM open source en local :

- Astuce 1 : Priorisez la VRAM. La mémoire vidéo de votre carte graphique est le facteur le plus important pour la performance des LLM. Investir dans une carte graphique avec au moins 8 Go de VRAM peut faire une énorme différence.

- Astuce 2 : Exploitez n8n en local. n8n vous permet d’automatiser des tâches complexes en combinant l’IA locale avec d’autres outils et services. Combinez par exemple n8n avec des Agents IA autonomes pour une productivité maximale. Pour le développement de code local, pensez à l’extension VS Code Continue.dev.

- Astuce 3 : Maîtrisez le « prompt engineering ». La qualité des résultats dépend fortement de la qualité de vos prompts. Expérimentez avec différentes formulations et techniques pour obtenir les réponses les plus pertinentes.

En adoptant ces stratégies et en restant à l’affût des dernières avancées, vous serez en mesure de maximiser la valeur ajoutée des LLM open source en local et de transformer votre façon de travailler. N’oubliez pas que la souveraineté numérique est un atout précieux dans un monde de plus en plus connecté et complexe.

Conclusion

En installant et en utilisant des LLM open source en local, vous prenez le contrôle de votre infrastructure IA. Vous garantissez la confidentialité de vos données, vous vous affranchissez de la dépendance à des services externes et vous explorez de nouvelles avenues de productivité.

Ollama et LM Studio sont des outils puissants et accessibles qui permettent à chacun de bénéficier de la puissance de l’IA, tout en conservant la maîtrise de ses données et de son environnement. Adoptez dès aujourd’hui cette approche souveraine de l’intelligence artificielle.

L’intégration de ces outils dans votre flux de travail représente un investissement dans votre autonomie numérique et une opportunité d’optimiser vos flux de revenus grâce à une automatisation sémantique plus efficace. N’hésitez pas à explorer les nombreuses possibilités offertes par ces solutions.

DEVENEZ UN MÉDIA FOOT AVEC L’IA

Apprenez à transformer l’actualité du football en vidéos virales. Utilisez l’IA pour automatiser vos scripts et montages afin de bâtir une audience rentable sur YouTube et les réseaux sociaux.

FAQ

1. Qu’est-ce qu’un LLM open source et pourquoi l’utiliser en local ?

Un LLM open source est un modèle de langage dont le code source est accessible et modifiable. L’utiliser en local permet de garantir la confidentialité des données, de travailler hors ligne et de personnaliser l’IA selon ses besoins.

2. Quels sont les avantages d’Ollama par rapport à LM Studio ?

Ollama est réputé pour sa simplicité d’installation et d’utilisation, tandis que LM Studio offre une plus grande flexibilité en termes de configuration et de choix de modèles. Le choix dépend de vos besoins spécifiques.

3. Comment installer Ollama sur Windows ?

Téléchargez l’installeur depuis le site officiel d’Ollama, exécutez-le et suivez les instructions. L’installation est généralement très simple et rapide.

4. Comment installer LM Studio sur Windows ?

Téléchargez l’application LM Studio depuis son site web, décompressez le fichier et exécutez l’application. Aucune installation complexe n’est requise.

5. Quels sont les modèles de langage compatibles avec Ollama et LM Studio ?

Ils sont compatibles avec une large gamme de modèles, notamment Llama 3.2, Mistral, et bien d’autres. Vous pouvez télécharger et installer les modèles de votre choix.

6. Comment choisir le bon modèle de langage pour mes besoins ?

Le choix du modèle dépend de la tâche que vous souhaitez accomplir. Les modèles plus grands sont généralement plus performants, mais ils nécessitent plus de ressources informatiques.

7. Quelle est la configuration matérielle minimale requise pour exécuter Ollama ou LM Studio ?

Une configuration avec au moins 8 Go de RAM et un processeur récent est recommandée pour des performances optimales.

8. Comment mettre à jour Ollama ou LM Studio ?

Ollama se met à jour automatiquement. LM Studio nécessite de télécharger la nouvelle version et de la remplacer.

9. Est-il possible d’utiliser Ollama ou LM Studio pour des applications professionnelles ?

Oui, ces outils peuvent être utilisés pour automatiser des tâches, générer du contenu, analyser des données et bien plus encore, tout en garantissant la conformité et la sécurité des informations.

10. Où trouver de l’aide et des ressources pour Ollama et LM Studio ?

Consultez les sites web officiels, les forums de discussion et les communautés en ligne dédiées à ces outils. Vous y trouverez de nombreux tutoriels et des réponses à vos questions.

AVERTISSEMENT : Les informations partagées sur ce site sont fournies à titre éducatif et informatif uniquement. Bien que nous nous efforcions d’offrir un contenu de haute qualité, nous ne garantissons aucun résultat spécifique. Astuces des Pro n’est pas un cabinet de conseil juridique, financier ou médical. Chaque lecteur reste l’unique responsable de l’usage qu’il fait de ces informations. Nous recommandons de consulter un professionnel qualifié avant toute décision stratégique. Sauf mention contraire, nous ne sommes affiliés à aucune institution citée.

🚀 Envie d'aller plus loin ? Découvrez notre méthode complète :

ACCÉDER À LA FORMATION IA FOOT CASH ➔